谷歌搜索引擎优化 (SEO)创建并提交 robots.txt 文件

您可以使用 robots.txt 文件控制抓取工具可以访问您网站上的哪些文件。robots.txt 文件应位于网站的根目录下。因此,对于网站 www.example.com,robots.txt 文件的路径应为 www.example.com/robots.txt。robots.txt 是一种遵循漫游器排除标准的纯文本文件,由一条或多条规则组成。每条规则可禁止或允许特定抓取工具抓取相应网站的指定文件路径下的文件。除非您在 robots.txt 文件中另行指定,否则所有文件均隐式允许抓取。

下面是一个包含两条规则的简单 robots.txt 文件:

User-agent: Googlebot

Disallow: /nogooglebot/

User-agent: *

Allow: /

Sitemap: http://www.example.com/sitemap.xml

以下是该 robots.txt 文件的含义:

1、名为 Googlebot 的用户代理不能抓取任何以 http://example.com/nogooglebot/ 开头的网址。

2、其他所有用户代理均可抓取整个网站。不指定这条规则也无妨,结果是一样的;默认行为是用户代理可以抓取整个网站。

3、该网站的站点地图文件路径为 http://www.example.com/sitemap.xml。

如需查看更多示例,请参阅语法部分。

创建 robots.txt 文件的基本准则

要创建 robots.txt 文件并使其在一般情况下具备可访问性和实用性,需要完成 4 个步骤:

1、创建一个名为 robots.txt 的文件。

2、向 robots.txt 文件添加规则。

3、将 robots.txt 文件上传到您的网站。

4、测试 robots.txt 文件。

创建 robots.txt 文件

您几乎可以使用任意文本编辑器创建 robots.txt 文件。例如,Notepad、TextEdit、vi 和 emacs 可用来创建有效的 robots.txt 文件。请勿使用文字处理软件,因为此类软件通常会将文件保存为专有格式,且可能会向文件中添加非预期的字符(如弯引号),这样可能会给抓取工具带来问题。如果保存文件时出现相应系统提示,请务必使用 UTF-8 编码保存文件。

格式和位置规则:

● 文件必须命名为 robots.txt。

● 网站只能有 1 个 robots.txt 文件。

● robots.txt 文件必须位于其要应用到的网站主机的根目录下。例如,若要控制对 https://www.example.com/ 下所有网址的抓取,就必须将 robots.txt 文件放在 https://www.example.com/robots.txt 下,一定不能将其放在子目录中(例如 https://example.com/pages/robots.txt 下)。如果您不确定如何访问自己的网站根目录,或者需要相应权限才能访问,请与网站托管服务提供商联系。如果您无法访问网站根目录,请改用其他屏蔽方法(例如元标记)。

● robots.txt 文件可应用到子网域(例如 https://website.example.com/robots.txt)或非标准端口(例如 http://example.com:8181/robots.txt)。

● robots.txt 文件必须是采用 UTF-8 编码(包括 ASCII)的文本文件。Google 可能会忽略不属于 UTF-8 范围的字符,从而可能会导致 robots.txt 规则无效。

向 robots.txt 文件添加规则

规则是关于抓取工具可以抓取网站哪些部分的说明。向 robots.txt 文件中添加规则时,请遵循以下准则:

● robots.txt 文件包含一个或多个组。

● 每个组由多条规则或指令(命令)组成,每条指令各占一行。每个组都以 User-agent 行开头,该行指定了组适用的目标。

● 每个组包含以下信息:

* 组的适用对象(用户代理)

* 代理可以访问的目录或文件。

* 代理无法访问的目录或文件。

● 抓取工具会按从上到下的顺序处理组。一个用户代理只能匹配 1 个规则集(即与相应用户代理匹配的比较早的最具体组)。

● 系统的默认假设是:用户代理可以抓取所有未被 disallow 规则屏蔽的网页或目录。

● 规则区分大小写。例如,disallow: /file.asp 适用于 https://www.example.com/file.asp,但不适用于 https://www.example.com/FILE.asp。

● # 字符表示注释的开始处。

Google 的抓取工具支持 robots.txt 文件中的以下指令:

● user-agent: [必需,每个组需含一个或多个 User-agent 条目] 该指令指定了规则适用的自动客户端(即搜索引擎抓取工具)的名称。这是每个规则组的首行内容。Google 用户代理列表中列出了 Google 用户代理名称。 使用星号 (*) 会匹配除各种 AdsBot 抓取工具之外的所有抓取工具,AdsBot 抓取工具必须明确指定。例如:

# Example 1: Block only Googlebot

User-agent: Googlebot

Disallow: /

# Example 2: Block Googlebot and Ad***ot

User-agent: Googlebot

User-agent: AdsBot-Google

Disallow: /

# Example 3: Block all but AdsBot crawlers

User-agent: *

Disallow: /

● disallow: [每条规则需含至少一个或多个 disallow 或 allow 条目] 您不希望用户代理抓取的目录或网页(相对于根网域而言)。如果规则引用了某个网页,则必须提供浏览器中显示的完整网页名称。它必须以 / 字符开头;如果它引用了某个目录,则必须以 / 标记结尾。

● allow: [每条规则需含至少一个或多个 disallow 或 allow 条目] 上文中提到的用户代理可以抓取的目录或网页(相对于根网域而言)。此指令用于替换 disallow 指令,从而允许抓取已禁止访问的目录中的子目录或网页。对于单个网页,请指定浏览器中显示的完整网页名称。对于目录,请用 / 标记结束规则。

● sitemap: [可选,每个文件可含零个或多个 sitemap 条目] 相应网站的站点地图的位置。站点地图网址必须是完全限定的网址;Google 不会假定存在或检查是否存在 http、https、www、非 www 网址变体。站点地图是一种用于指示 Google 应抓取哪些内容的理想方式,但并不用于指示 Google 可以抓取或不能抓取哪些内容。详细了解站点地图。 示例:

Sitemap: https://example.com/sitemap.xml

Sitemap: http://www.example.com/sitemap.xml

除 sitemap 之外的所有指令都支持使用通配符 * 表示路径前缀、后缀或整个字符串。

与这些指令均不匹配的行将被忽略。

如需有关每个指令的完整说明,请参阅 Google 对 robots.txt 规范的解释页面。

上传 robots.txt 文件

将 robots.txt 文件保存到计算机后,您便可以将其提供给搜索引擎抓取工具。没有一个统一工具可以帮助您完成这项工作,因为如何将 robots.txt 文件上传到网站取决于您的网站和服务器架构。请与您的托管公司联系,或在托管公司的文档中进行搜索;例如,搜索"上传文件 infomaniak"。

上传 robots.txt 文件后,请测试该文件是否可公开访问,以及 Google 能否解析该文件。

测试 robots.txt 标记

要测试新上传的 robots.txt 文件是否可公开访问,请在浏览器中打开无痕浏览窗口(或等效窗口),然后转到 robots.txt 文件的位置。例如:https://example.com/robots.txt。如果您看到 robots.txt 文件的内容,就可准备测试标记了。

Google 提供了两种测试 robots.txt 标记的方式:

1、Search Console 中的 robots.txt 测试工具。您只能针对您网站上可供访问的 robots.txt 文件使用此工具。

2、如果您是开发者,请了解并构建 Google 的开源 robots.txt 库,该库也用在 Google 搜索中。您可以使用此工具在计算机上本地测试 robots.txt 文件。

向 Google 提交 robots.txt 文件

在您上传并测试 robots.txt 文件后,Google 的抓取工具会自动找到并开始使用您的 robots.txt 文件。您无需采取任何操作。如果您更新了 robots.txt 文件,并需要尽快刷新 Google 的缓存副本,请了解如何提交更新后的 robots.txt 文件。

实用的 robots.txt 规则

下面是一些常见的实用 robots.txt 规则:

实用规则禁止抓取整个网站请注意,在某些情况下,Google 即使未抓取网站的网址,仍可能将其编入索引。注意:这不适用于各种 AdsBot 抓取工具,此类抓取工具必须明确指定。

User-agent: *

Disallow: /禁止抓取某一目录及其内容在目录名后添加一道正斜线,即可禁止抓取整个目录。禁止抓取的目录字符串可以出现在路径中的任何位置,因此 Disallow: /junk/ 与 https://example.com/junk/ 和 https://example.com/for-sale/other/junk/ 均匹配。

注意:请勿使用 robots.txt 禁止访问私密内容;请改用正确的身份验证机制。对于 robots.txt 文件所禁止抓取的网址,Google 仍可能会在不进行抓取的情况下将其编入索引;另外,由于 robots.txt 文件可供任何人随意查看,因此可能会泄露您的私密内容的位置。

User-agent: *

Disallow: /calendar/

Disallow: /junk/

Disallow: /books/fiction/contemporary/

仅允许某一抓取工具访问网站内容只有 googlebot-news 可以抓取整个网站。

User-agent: Googlebot-news

Allow: /

User-agent: *

Disallow: /允许除某一抓取工具以外的其他所有抓取工具访问网站内容Unnecessarybot 不能抓取相应网站,所有其他漫游器都可以。

User-agent: Unnecessarybot

Disallow: /

User-agent: *

Allow: /禁止抓取某一网页例如,禁止抓取 useless_file.Html 网页。

User-agent: *

Disallow: /useless_file.html禁止 Google 图片访问某一特定图片例如,禁止访问 dogs.jpg 图片。

User-agent: Googlebot-Image

Disallow: /images/dogs.jpg禁止 Google 图片访问您网站上的所有图片如果无法抓取图片和视频,则 Google 无法将其编入索引。

User-agent: Googlebot-Image

Disallow: /

禁止抓取某一特定文件类型的文件例如,禁止抓取所有 .gif 文件。

User-agent: Googlebot

Disallow: /*.gif$禁止抓取整个网站,但允许 Mediapartners-Google 访问内容实施此规则会阻止您的网页显示在搜索结果中,但 Mediapartners-Google 网页抓取工具仍能分析这些网页,以确定要向访问您网站的用户显示哪些广告。

User-agent: *

Disallow: /

User-agent: Mediapartners-Google

Allow: /使用 $ 匹配以特定字符串结尾的网址例如,禁止抓取所有 .xls 文件。

User-agent: Googlebot

Disallow: /*.xls$

TAG:谷歌搜索引擎怎么优化

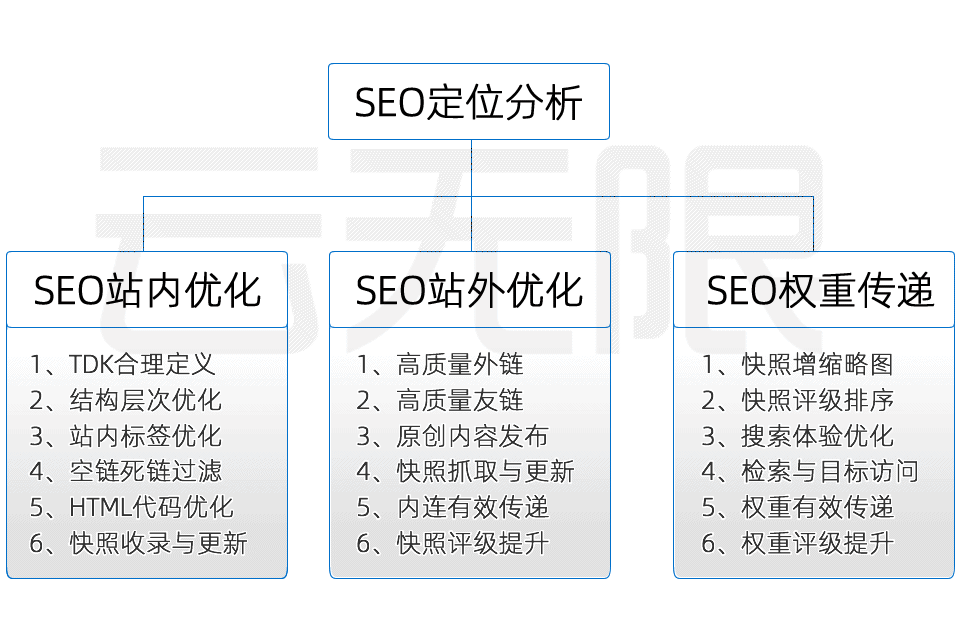

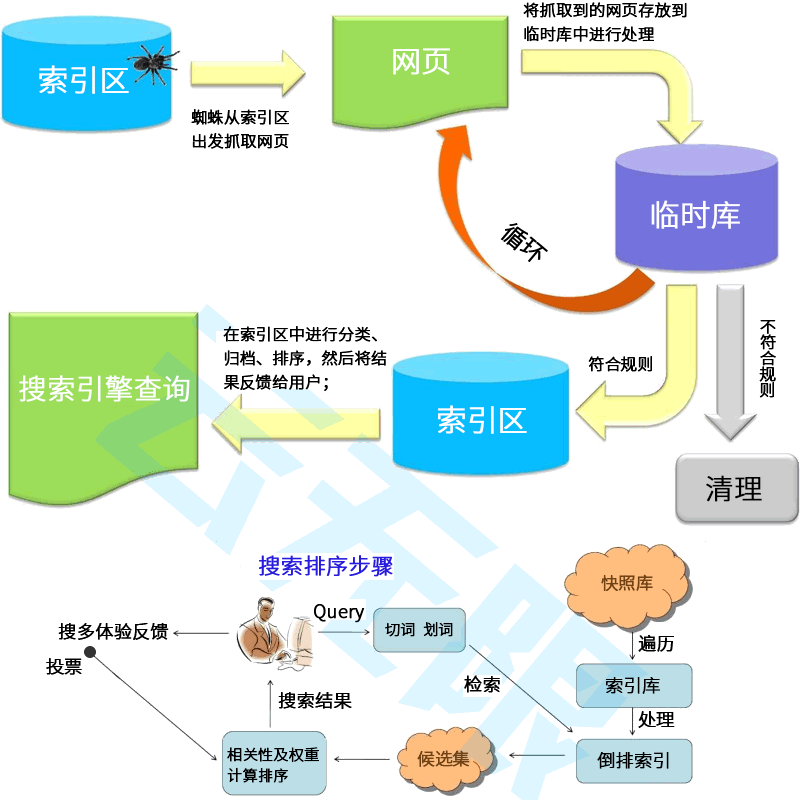

SEO就是搜索引擎优化:让你的网站在搜索引擎(比如百度、谷歌)的排名更靠前,当用户通过关键词搜索时更容易搜到你的网站,从而实现企业品牌曝光、主动获客和营销推广的目标。为什么要做SEO?

提高网站访问量:SEO能让你的网站在搜索引擎结果中更靠前,吸引更多客户点击。

降低市场营销成本:相比于付费广告,SEO是一种更经济有效的营销方式。

提升品牌知名度:网站排名靠前,可以让更多用户看到你的品牌名称和信息,增强品牌影响力。

SEO优化有哪些优势?

SEO优化有哪些优势?成本低廉:主要成本是优化师的工资。

效果稳定:一旦网站排名上升,效果稳定持久,可持续获得展现机会。

不受地域限制:SEO的效果可以覆盖全球,不受时间和空间的限制。

什么样的公司更适合做SEO优化呢?大多数行业都可以从SEO中受益。特别是那些希望用户主动访问我们的网站、降低营销成本、提升品牌知名度的企业。通过SEO来优化自己的网站,可吸引更多潜在客户。

SEO是一种工人的有效的网络营销手段,可以帮助企业提升关键词排名,吸引更多用户,实现商业目标。SEO是一个长期且专业的技术,企业在进行SEO时,必须耐心优化,因为SEO涉及到的不止是网站结构、内容质量、用户体验、外部链接这几个方面;还有算法的更替、蜘蛛的引导、快照的更新、参与排序的权重等。

SEO策略

搜到你

让用户搜到你的网站是做SEO优化的目标,拥有精湛的SEO技术、丰富的经验技巧以及对SEO规则的深刻把握才有机会获得更云无限!

了解你

确保网站内容清晰、准确、易于理解,使用户能够轻松找到所需信息.使用简洁明了的标题和描述,帮助用户快速了解你的产品服务!

信任你

将企业的核心价值、差异化卖点、吸引眼球的宣传语等品牌词尽可能多的占位搜索前几页,增强用户印象,优化用户体验让访客信任你!

选择你

优化落地页引导用户咨询或预约留言,引用大型案例或权威报道彰显品牌实力,关注用户需求和反馈,不断优化产品服务让用户选择你!

关键词研究

品牌关键词

提升品牌知名度、塑造品牌形象,吸引对品牌感兴趣的用户,同时帮助监测品牌在搜索引擎中的表现。

核心关键词

是网站内容的主要焦点,能吸引大量目标受众,提高网站在相关搜索中的排名。搜索量大,竞争较激烈。

长尾关键词

更能够更精确地定位目标受众,提高转化率,竞争相对较小更容易获得排名,更符合用户的具体搜索意图。

区域关键词

针对特定地区进行优化,帮助本地企业吸引当地用户,提高本地市场的曝光度。适用于有地域性需求的企业。

竞品关键词

与竞争对手品牌或产品相关的词,通过分析这些关键词,可以了解竞争对手的优势和劣势。

产品关键词

直接针对产品进行优化,与具体产品或服务直接相关,如产品名称、型号、功能等描述性词汇。

搜索下拉词

反映用户的搜索习惯和需求,是搜索引擎根据用户输入自动推荐的词汇,与用户搜索意图高度相关。

相关搜索词

提供与主题相关的其他搜索词汇,帮助用户发现更多相关内容,同时扩展网站的优化范围。

站内SEO

TDK优化

力争一次性完成网站页面标题、描述、关键词的的合理部署

链接优化

包含LOGO链接、导航链接、文章链接及外部链接等SEO优化设置

HTML优化

HTML代码、标签等优化:H,alt,strong,title,span,title等标签

内容优化

固定内容与关键词SEO匹配、动态内容提升蜘蛛抓取率增强快照评级

站外SEO

1)降低文章内容在搜索结果的重合度。尤其是文章标题、段落主题、内容摘要等;

2)标题包含关键词(可包含部分或完整匹配)字数控制在24字内;

3)提炼的文章概要(100字内)必须与关键词有相关性才有意义;

4)新文章不要增加锚文本超链接,等文章快照有排名后再扩充锚文本链接;

5)文章内容与标题关键词相呼应,建立关联,也可根据关键词扩充有关的内容;

6)文章中的图片最好增加alt属性,图片不要失真和变形,宽度大于500px更优机会抢占搜索快照缩略图;

7)文章排版合理、段落分明、段落主题用H标签加强,段落内容用span或p标签区分;

8)发布文章后先引导收录。如提交搜索引擎登录、合理使用有排名快照的内部链接;

9)如果文章7天还没有收录,就要提升文章内容质量再发布;

SEO优化

SEO优化  搜索引擎SEO

搜索引擎SEO